@TailosiveEV

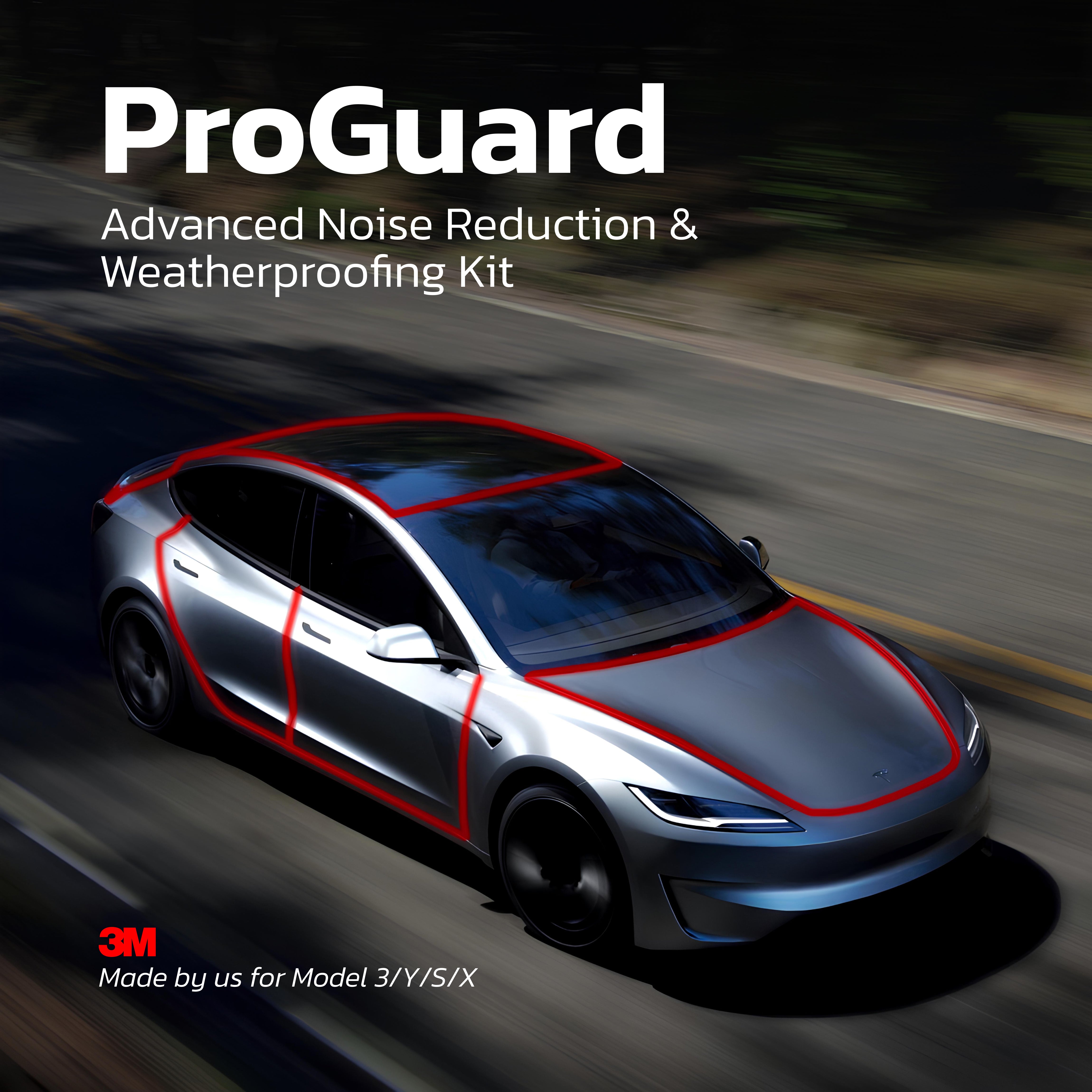

Un nuovo gruppo di veicoli Tesla per la convalida ingegneristica è stato avvistato a Los Gatos, in California, mostrando insolite modifiche hardware. A differenza dei muletti di convalida standard visti negli anni passati, solitamente dotati di sistemi LiDAR montati sul tetto per il ground-truthing, questi esemplari, un Cybertruck e una Model 3, montano un sistema di telecamere personalizzato installato agli angoli del paraurti anteriore.

@TailosiveEV

Le staffe dall'aspetto provvisorio posizionano telecamere grandangolari basse rispetto al suolo e orientate verso l'esterno. Sebbene Tesla testi regolarmente nuovi sensori, il posizionamento di telecamere in queste zone angolari—che coprono punti ciechi frontali difficili da catturare con l'attuale configurazione delle telecamere—indica che l'azienda sta raccogliendo dati mirati per affrontare due problemi chiave: Summon e Banish.

Dati di riferimento

L'approccio visivo di Tesla si basa su occupancy network—software che prevede gli oggetti nei punti ciechi ricordando ciò che l'auto ha osservato pochi secondi prima. Quella memoria è particolarmente importante per il Cybertruck perché le telecamere frontali non riescono a vedere alcune aree attorno ai paraurti.

La sola memoria non basta per le manovre precise a bassa velocità richieste da Summon e Banish. Combinando queste telecamere montate in basso agli angoli con un LiDAR sul tetto ad alta fedeltà, Tesla sembra stia costruendo un nuovo dataset di riferimento: una rappresentazione pixel-perfect dell'area immediatamente attorno al paraurti.

Quel dataset può addestrare le reti neurali di FSD a dedurre meglio distanza e volume degli ostacoli all'interno della zona cieca. In breve, Tesla sta insegnando ai suoi sistemi a prevedere gli oggetti nel "vuoto" dove le telecamere di produzione non hanno una visione diretta, riducendo il rischio di urtare ostacoli durante manovre strette.

Il collo di bottiglia di Banish

La necessità di questo test ha una duplice motivazione. Banish è una funzionalità fondamentale per Robotaxi e FSD Unsupervised, e il Cybertruck resta l'unico veicolo della gamma Tesla privo di Actually Smart Summon.

Gran parte della flotta ora esegue FSD v14, ma Actually Smart Summon continua a funzionare su uno stack legacy più vecchio che non è stato migrato nella rete neurale end-to-end unificata. Quel codice legacy dipende in gran parte da routine Autopilot che non sono state portate sul Cybertruck.

Banish consente a un'auto di lasciarti davanti a una porta e poi muoversi autonomamente in un parcheggio per trovare un posto libero. La funzione—promessa nelle precedenti release di FSD—richiede che il veicolo gestisca traffico complesso e imprevedibile nei parcheggi senza un umano al volante, senza alcun margine di errore.

Per evitare incidenti, i modelli di visione anteriore di Tesla devono raggiungere una precisione al millimetro nei punti ciechi frontali, così che Banish e Smart Summon possano funzionare in sicurezza.

Uno sguardo all'hardware futuro?

Anche se le staffe in queste foto sembrano provvisorie, il test solleva la domanda se Tesla aggiungerà telecamere dedicate agli angoli nelle future revisioni hardware o risolverà il problema solo via software.

Concorrenti come Lucid e Rivian usano telecamere aggiuntive, radar o sensori a ultrasuoni per coprire queste aree cieche. Tesla aveva in precedenza rimosso i sensori a ultrasuoni per ridurre costi e complessità e per diminuire i conflitti tra sensori; affidarsi solo a telecamere montate in alto si è rivelato impegnativo.

Da tempo si chiedono telecamere nel paraurti anteriore, perché eliminerebbero il punto cieco frontale e consentirebbero ai veicoli di vedere prima gli ostacoli agli incroci. Attualmente, spesso un veicolo deve avanzare abbastanza perché le telecamere del montante B ottengano una visuale chiara.

Detto questo, un retrofit o un improvviso restyling di metà ciclo con l'aggiunta di telecamere agli angoli sembra improbabile. Questa attività è molto probabilmente un'operazione di raccolta dati finalizzata a migliorare le prestazioni software sull'hardware esistente.

Condividi:

Uovo di Pasqua "Mars Mode" di Tesla: ultime novità

Tesla ha un freno d'emergenza: ecco come usarlo